Hackear um modelo de aprendizagem de máquina pode ser mais factível do que você imagina, e sua robustez em relação a ataques adversariais tem sido uma preocupação crescente no desenvolvimento da inteligência artificial. Embora esteja ainda em seus estágios iniciais de desenvolvimento, esse tópico tornou-se ativo e desafiador não apenas na academia, mas também na indústria

Durante esses ataques adversariais, hackers mal-intencionados analisam a vulnerabilidade do modelo-alvo e projetam algoritmos de ataque para adulterar maliciosamente as amostras de entrada, delibeardamente comprometendo o desempenho do modelo. Posto em outros termos, esses ataques geralmente consistem em manipular as entradas para enganar o modelo e provocar resultados incorretos.

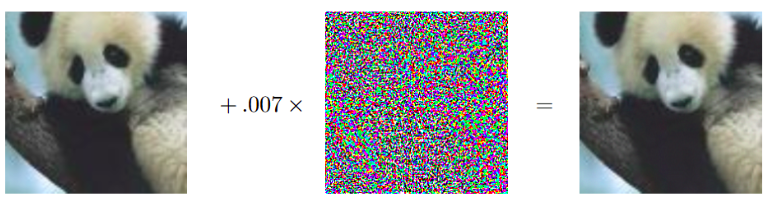

A literatura tem mostrado que, mesmo com pequenas perturbações imperceptíveis ao olho humano, os modelos de aprendizado de máquina podem ser induzidos a cometer erros graves, revelando uma fragilidade alarmante. Em particular, muitos dos algoritmos existentes não conseguem descrever efetivamente as características essenciais dos dados, tornando-os incapazes de fornecer o resultado correto diante de entradas maliciosas.

Ataques adversariais geralmente começam com a introdução de pequenas perturbações nas entradas, com o objetivo de confundir os modelos.

A vulnerabilidade dos modelos de machine learning a ataques adversariais foi provavelmente primeiramente destacada em 2014, por Szegedy et al. [1], onde eles demonstraram que redes neurais artificiais profundas podem ser facilmente enganadas por pequenas perturbações nas entradas. Daí em diante, uma variedade de tipos ataques foi desenvolvida, incluindo, mas não se limitando a, ataques de whitebox e blackbox. Os ataques do tipo whitebox – ou de caixa branca – assumem que o atacante tem total conhecimento do modelo, de sua estrutura e parâmetros, enquanto os ataques blackbox – ou de caixa preta – assumem que o atacante não tem esse conhecimento, mas pode inferir informações através de consultas ao modelo.

A verdade é que, na maioria das situações reais, o adversário não tem o conhecimento da estrutura e funcionamento do modelo, o que torna os ataques blackbox uma alternativa viável. No caso dos ataques blackbox, os atacantes dependem apenas dos resultados retornados pelo acesso às consultas ao modelo para criar exemplos adversariais.

Os ataques adversariais mais comuns incluem o “Fast Gradient Sign Method” (FGSM), desenvolvido por Goodfellow et al. [2], que utiliza gradientes para criar perturbações adversariais, basicamente construindo amostras de ataque calculando o gradiente da função de perda do modelo alvo e procurando por perturbações adversariais ao longo da direção do gradiente, adicionando-as às amostras de entrada normais originais.

Outro ataque notório é o “Projected Gradient Descent” (PGD), uma extensão do FGSM que aplica múltiplas iterações para aumentar a eficácia do ataque. Além disso, há ataques como o “Carlini & Wagner” (C&W) [4], conhecido por ser altamente eficaz e difícil de detectar.

Um modelo atacado pode levar a consequências bastante negativas, especialmente em aplicações críticas como segurança, saúde e finanças. Apenas para citar um exemplo, imagine um ataque adversarial em um sistema de reconhecimento facial que poderia permitir que um invasor se passe por outra pessoa, comprometendo a segurança da aplicação. Em diagnósticos médicos assistidos por IA, um ataque pode levar a diagnósticos incorretos, colocando vidas em risco. No setor financeiro, modelos adversariamente atacados podem resultar em fraudes ou decisões financeiras errôneas.

Para mitigar esses riscos, a academia e a indústria têm investido significativamente no desenvolvimento de técnicas para toarnar os modelos mais robusotos contra ataques adversariais. Uma abordagem comum é o treinamento adversarial, onde o modelo é treinado com exemplos adversariais para aumentar sua resistência a tais ataques. Além disso, técnicas como a verificação formal de modelos e a detecção de anomalias são exploradas para identificar e mitigar tentativas de ataque antes que elas possam causar danos significativos .

A introdução de camadas de segurança adicionais e a utilização de algoritmos de aprendizado que sejam inerentemente mais robustos a perturbações adversariais é algo que deve ser sempre buscado em qualquer projeto de machine learning.

Apesar desses esforços, a corrida entre atacantes e defensores continua. Ataques mais sofisticados continuam a ser desenvolvidos, enquanto novas técnicas de defesa são constantemente aprimoradas. A colaboração entre academia e indústria é crucial para avançar nesse campo, combinando insights teóricos com aplicações práticas para desenvolver soluções mais eficazes e resilientes.

Algumas referências especializadas para você consultar

1. Szegedy, C., Zaremba, W., Sutskever, I., Bruna, J., Erhan, D., Goodfellow, I., & Fergus, R. (2014). Intriguing properties of neural networks. arXiv preprint arXiv:1312.6199.

2. Goodfellow, I. J., Shlens, J., & Szegedy, C. (2015). Explaining and harnessing adversarial examples. arXiv preprint arXiv:1412.6572.

3. Madry, A., Makelov, A., Schmidt, L., Tsipras, D., & Vladu, A. (2018). Towards deep learning models resistant to adversarial attacks. arXiv preprint arXiv:1706.06083.

4. Carlini, N., & Wagner, D. (2017). Towards evaluating the robustness of neural networks. In 2017 IEEE Symposium on Security and Privacy (SP) (pp. 39-57). IEEE.

5. Zhao R (2021) The vulnerability of the neural networks against adversarial examples in deep learning algorithms, in Proceedings – 2021 2nd International Conference on Computing and Data Science, CDS 2021, pp. 287–295. https://doi.org/10.1109/CDS52072.2021.00057

6. Bajaj, A., Vishwakarma, D.K. A state-of-the-art review on adversarial machine learning in image classification. Multimed Tools Appl 83, 9351–9416 (2024). https://doi.org/10.1007/s11042-023-15883-z